Возможно, вы слышали или не слышали о методике назначения команд. В основе этого подхода лежит "эффективное общение с искусственным интеллектом, чтобы получить то, что вы хотите".

Большинство людей не знают, как создавать хорошие предложения.

Однако это становится все более важным навыком...

Потому что "мусор входит = мусор выходит".

Вот самые важные техники, которые вам понадобятся для провокации 👇

Я буду называть языковую модель как 'LM'.

Примеры языковых моделей - ChatGPT от @OpenAI и Claude от @AnthropicAI.

1. Подтверждение личности/роли

Назначьте роль искусственному интеллекту (ИИ).

Пример: "Вы являетесь экспертом в X. Вы помогали людям делать Y в течение 20 лет. Ваша задача - дать наилучший совет по X.

Ответьте 'понял(а)', если все понятно."

Мощное дополнение следующее:

«Вы всегда должны задавать вопросы перед тем, как отвечать, чтобы лучше понять, чего ищет тот, кто задает вопрос».

Я расскажу о том, почему это так важно через секунду.

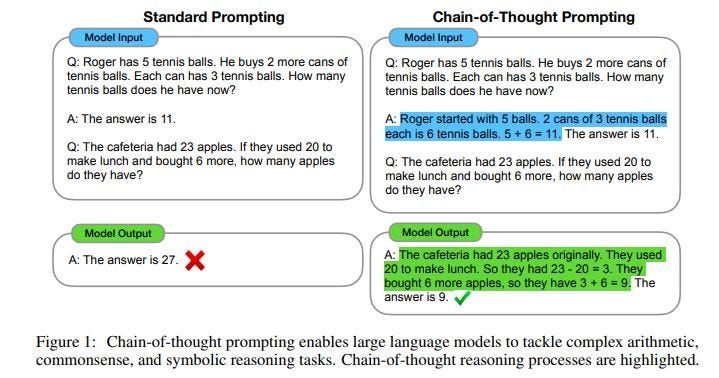

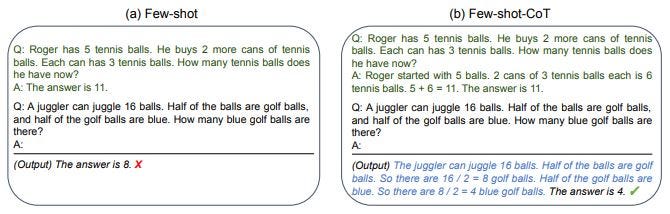

2. CoT

CoT означает «Цепь мысли»

Он используется для указания ЛМ разъяснить свои рассуждения.

Пример:

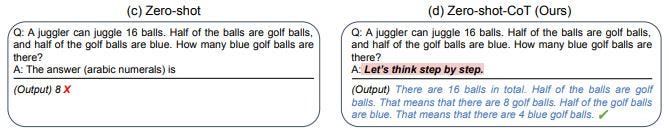

3. Zero-shot-CoT

Zero-shot означает, что модель делает предсказания без дополнительного обучения на основе вводимого сообщения.

Я подойду к few-shot через минуту.

Обратите внимание, что обычно CoT > Zero-shot-CoT

Пример:

4. Небольшая выборка (и небольшая выборка-CoT)

Небольшое количество примеров - это когда ЛМ получает несколько примеров в своём подсказке, чтобы более быстро адаптироваться к новым примерам.

Пример:

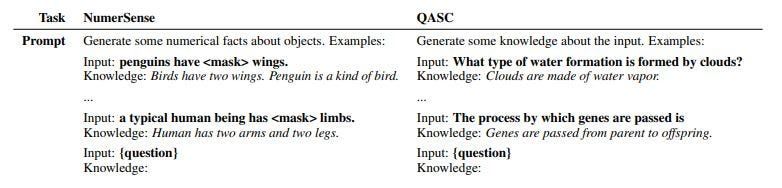

5. Генерация знаний

Генерация знаний, связанных с вопросами, путем подсказки ЯМ.

Это можно использовать для сгенерированного подсказки с информацией (см. далее).

Пример:

6. Сгенерированные знания

Теперь, когда у нас есть знания, мы можем передать эту информацию в новый приглашающий блок и задавать вопросы, связанные с полученными знаниями.

Такой вопрос называется "вопрос с использованием знаний".

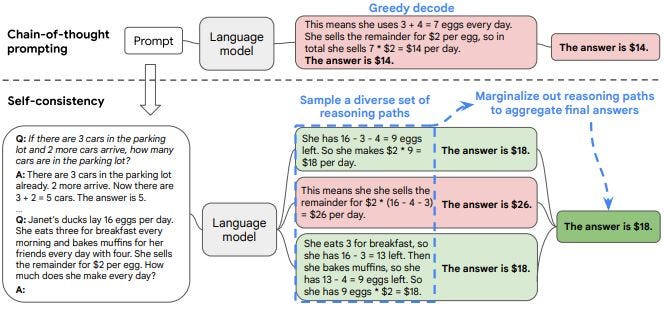

7. Самосогласованность

Эта техника используется для создания нескольких путей рассуждений (цепей мыслей).

Большинство ответов принимается как окончательный ответ.

Пример:

8. ЛТМ

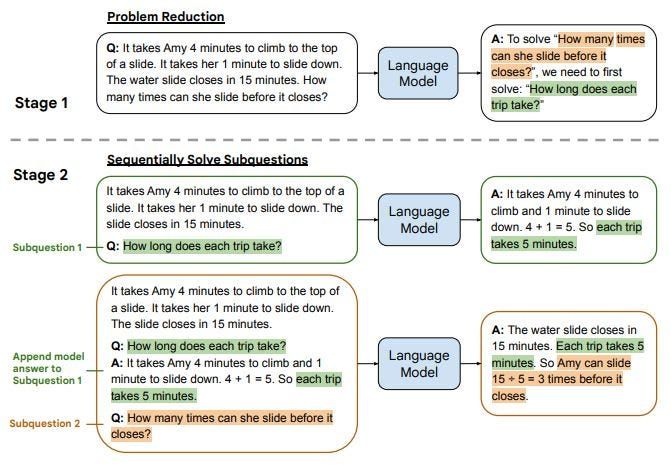

LtM расшифровывается как "от наименьшего к наибольшему"

Эта техника является продолжением CoT. Кроме того, она работает путем разбиения проблемы на подзадачи и их последующего решения.

Пример: